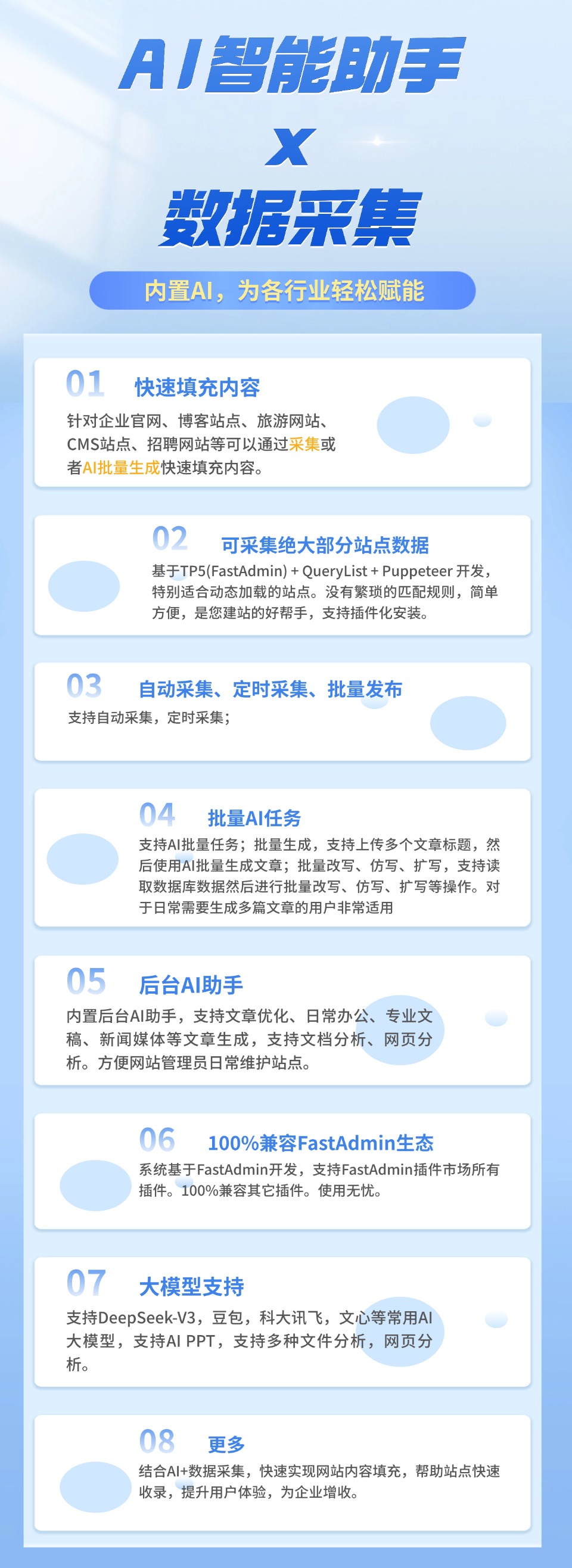

在当前人工智能技术迅猛发展的背景下,FastAdmin网站引入AI生成内容已成为提升运营效率的重要手段。然而,在享受技术红利的同时,平台也必须直面隐私与伦理边界带来的挑战,尤其是在数据采集、用户信息保护及内容合规方面可能引发的法律风险。

首先,隐私与伦理边界是FastAdmin网站在部署AI系统过程中不可忽视的核心议题。AI模型依赖大量数据进行训练,若这些数据包含用户个人信息或敏感行为记录,而未经明确授权获取或匿名化处理,极易违反《个人信息保护法》等相关法律法规。例如,若FastAdmin在未告知用户的情况下,利用其后台操作日志训练AI生成推荐内容,就可能构成对用户隐私权的侵犯。因此,平台必须建立完善的数据使用规范,确保所有数据来源合法、用途透明,并赋予用户充分的知情权和选择权。

其次,在内容生成环节,AI可能因训练数据偏差而输出带有歧视性、误导性甚至违法的信息,这同样触及隐私与伦理边界的底线。比如,AI自动生成的文章若涉及特定个人的负面评价,即便未直接点名,也可能通过上下文推断出身份,造成“间接识别”,从而构成对个人隐私的侵害。此外,若AI模仿特定写作风格或复制受版权保护的内容片段,还可能引发知识产权纠纷。对此,FastAdmin应建立内容审核机制,结合人工与自动化工具,对AI输出进行多层过滤,防止越界内容传播。

再者,从伦理角度看,AI生成内容的“真实性”与“责任归属”问题也需纳入考量。当用户无法分辨内容是由人类还是机器生成时,平台是否应主动标注“AI生成”?这一做法不仅关乎信息透明度,更是维护用户信任的关键。根据《互联网信息服务算法推荐管理规定》,提供生成式人工智能服务的平台有义务进行显著标识。忽视这一点,不仅模糊了隐私与伦理边界,也可能导致监管处罚。FastAdmin作为技术应用方,应主动承担社会责任,推动AI使用的公开与可追溯。

最后,随着国家对AI治理框架的不断完善,FastAdmin网站还需关注地方性法规和行业标准的动态变化。例如,某些地区已开始试点“AI内容备案制”,要求平台对高风险AI应用场景进行事前评估。在此背景下,平台应设立专门的合规团队,定期开展隐私影响评估(PIA),并针对AI系统的训练数据、算法逻辑和输出结果进行审计,确保整个流程符合现行法律要求。

综上所述,隐私与伦理边界不仅是技术应用的红线,更是FastAdmin网站可持续发展的基石。只有在尊重用户权利、遵守法律法规的前提下,合理、审慎地使用AI生成内容,才能真正实现技术创新与社会价值的双赢。未来,随着监管体系的成熟,平台更应主动引领行业规范,将隐私保护与伦理考量深度融入产品设计之中,构建安全可信的数字生态。

后台体验地址:https://demo.gzybo.net/demo.php

移动端体验地址:https://demo.gzybo.net/wx

账号:demo

密码:123456

联系我们

发表评论 取消回复